Generative Fill – Die Adobe KI im Test

Auch Adobe will den rasant wachsenden Markt KI basierender Grafik-Tools erobern. Der jüngste Wurf des Marktführers heißt Adobe Generative AI Beta und wird derzeit auf Social Media mit Prophezeiungen wie »This changes everything« beworben. In Photoshop Beta ist der Bildgenerator unter dem Namen »Generative Fill«integriert.

Zunächst einmal ein Spoiler: Auch das hier geschilderte KI-Tool wird zukünftig weder den Inhouse-Grafiker ersetzen, noch hilft es dabei, sich die Kosten für Designleistungen komplett zu ersparen. Und: KI-Tools machen einen Grafikdesigner nicht unbedingt besser. Aber etwas schneller.

»This changes everything« – Künstliche Intelligenz und Schwarmbegeisterung.

Die Begriffe »Magie«, »Künstliche Intelligenz« und »Gamechanger« haben derzeit Hochkonjunktur. Vor allem in Internetforen und Social-Media-Kanälen. Wenn Sie im Marketing tätig sind, kennen Sie vermutlich auch dieses Phänomen: Sucht man auf YouTube bestimme Begriffe wie »Künstliche Intelligenz« oder »ChatGPT« oder »Midjourney«, dauert es keine zwei Tage, bis der eigene Feed nicht mehr wiederzuerkennen ist: »So wirst du mit ChatGPT reich«, »Dieses KI-Tool kennst du vermutlich noch nicht«, »Dieses KI-Gadget ändern alles«. Kurz gesagt, man findet sich in einer Kakophonie von unzähligen seriösen bis unseriösen KI-Empfehlungs-Videos wieder. Die meisten davon sind aber weder besonders eindrucksvoll, noch der Mühe wert, sich näher damit zu beschäftigen.

Sehr intensiv beworben wird vor allem das jüngste KI-Produkt von Adobe »Generative Fill«. Und da Adobe immerhin der Marktführer bei Designsoftware ist, lohnt es sich meiner Meinung nach, hier genauer hinzuschauen.

ChatGPT (Generative Pre-trained Transformer)ist ein Chatbot, der künstliche Intelligenz einsetzt, um mit Nutzern über textbasierte Nachrichten zu kommunizieren.

Quelle: https://de.wikipedia.org/wiki/ChatGPT 02.06.2023

Generatives Füllen – Bilder per Texteingabe erzeugen.

Generative Fill, das Füllen und Erzeugen von Bildern mithilfe eines Computerprogramms, ist eine KI-Funktion in der neuen Beta-Version der Software Photoshop. Sie basiert auf Adobe Firefly, einer Familie von KI-Modellen, die auf die Generierung von Bildern und Texteffekten fokussiert ist. Basierend auf Millionen von Bildern, die zum Training der KI genutzt wurden, werden automatisch und über s.g. Prompts (Texteingaben) völlig neue Pixel & Bilder erzeugt. Wenn Sie übrigens mehr über Machine Learning wissen wollen: In meiner Linkliste am Ende dieses Blogs finden Sie einige Grundlagen-Artikel dazu.

Prompt – Bezeichnet die (Text)eingabe des Benutzers bei einer generativen KI (Generative AI), zu welcher das System einen Output erzeugt (bspw. Bild oder Text).

Generative Fill – Was kann das Tool tatsächlich?

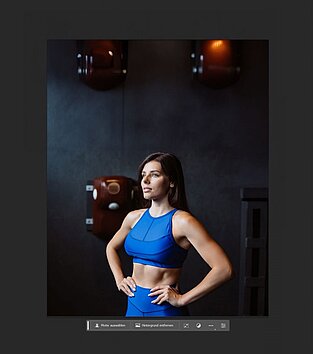

Doch wie genau funktioniert Generative Fill? Um diese Frage beantworten zu können, werde ich Ihnen die ich Ihnen die Vor- und Nachteile von Generative Fill näherbringen. Und zwar anhand eines konkreten Beispiels, den ich Schritt für Schritt rekonstruieren werde

Doch bevor wir loslegen noch ein paar Erklärungen, damit Sie ein Gespür dafür bekommen, mit welchen Hürden Grafiker bei ihrer täglichen Arbeit zu kämpfen haben.

Als Grafikdesigner muss man oft mühsame Kleinarbeiten erledigen, bevor man sich ans eigentliche Komponieren eines Sujets, einer Werbeanzeige, o.Ä. machen kann. Dazu zählen u.a. das Freistellen von Objekten, das Ersetzen von Bildteilen (Himmel, Berge, Wolken, etc.) oder das (foto)realistische Einfügen neuer Objekte. Photoshop verfügt bereits jetzt über viele Funktionen, die diese Aufgaben erleichtern: etwa die »Inhaltsbasierte Füllung« oder die zahlreichen Möglichkeiten für präzises Maskieren von Objekten.

Generative Fill soll nun all diese Arbeitsschritte automatisch und mittels Texteingabe für den User erledigen. Kein mühsames Suchen nach passenden Stockfotos, kein anschließendes Freistellen und Einfügen mehr. Das alles macht die KI in wenigen Sekunden. So zumindest die Prämisse.

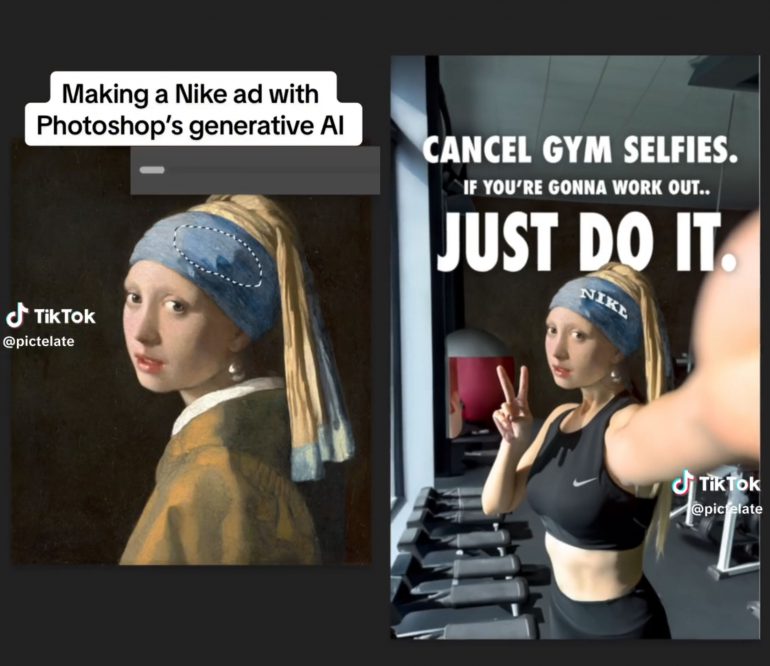

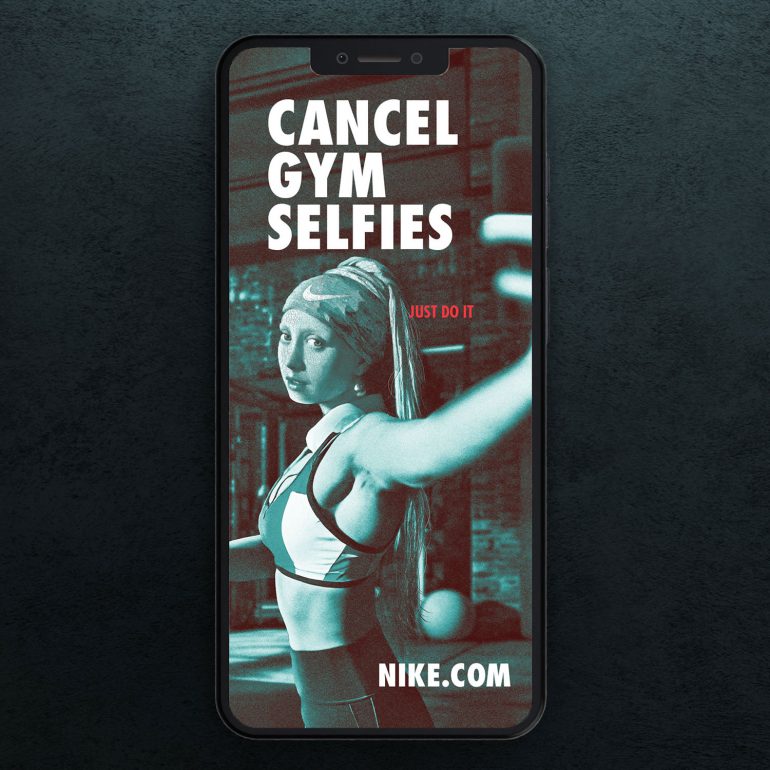

Kling großartig? Nun, als Designer mit langjähriger Erfahrung habe ich mir angewöhnt, besonders genau hinzuschauen, wenn technische Innovationen sehr schnell gehypt und euphorisch bejubelt werden. Und bin dabei auf ein TikTok-Video gestoßen. Dort ist zu sehen, wie der TikTok-User @pictelate mithilfe von Generative Fill eine kreative Werbeanzeige erstellt. Und auch wenn es sich hier nur um ein Spaß-Video ohne Anspruch auf große Kunst handelt, suggeriert dieses Video, dass jeder mithilfe einer KI im Handumdrehen und ohne besondere Vorkenntnisse die Arbeit eines Werbegrafikers erledigen kann.

Ich hatte meine Zweifel, ob das wirklich so einfach geht. Wollte es aber genau wissen und habe die Arbeitsschritte einfach nachgestellt. Hier das Ergebnis.

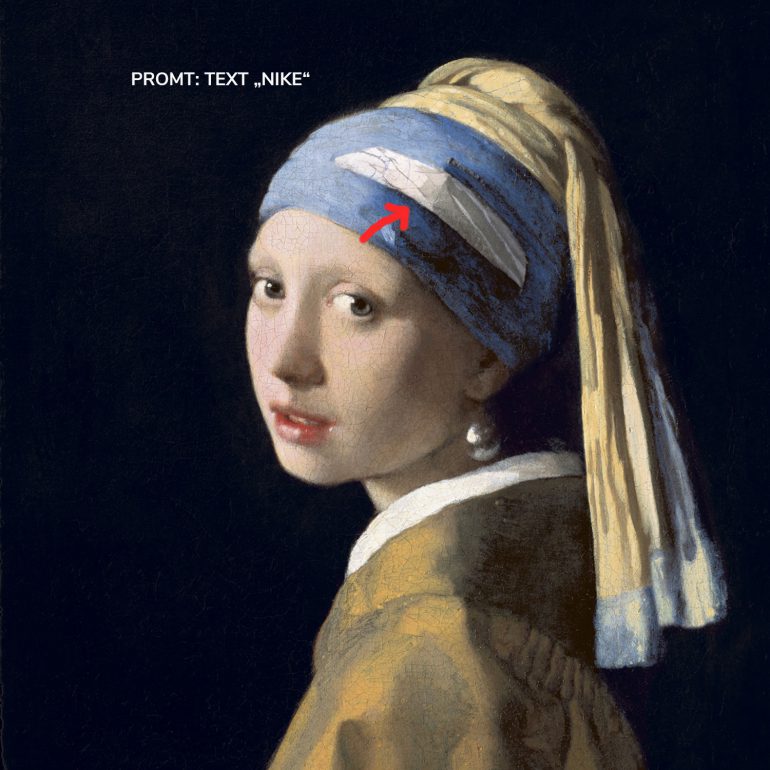

Schritt 1 – Kann KI Text?

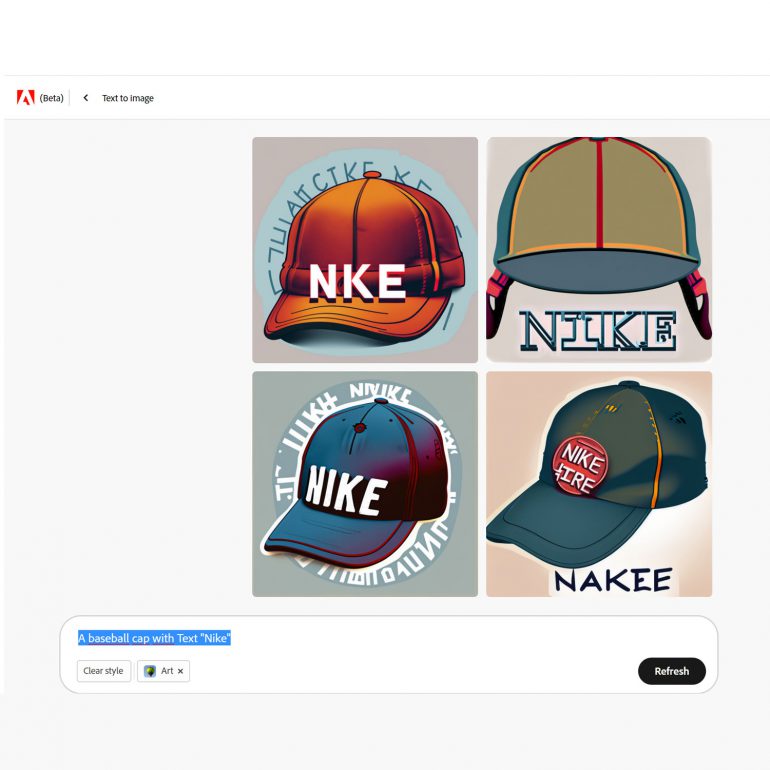

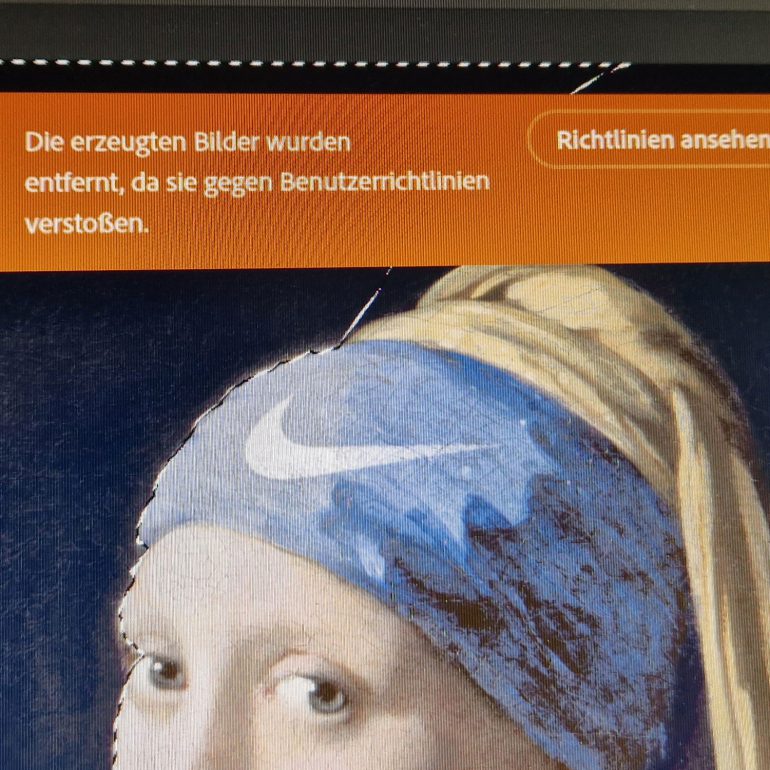

Der mutmaßlich einfachste Schritt am Anfang des Videos, den Nike-Schriftzug auf das Kopftuch zu bringen, erwies sich bereits schwieriger als gedacht. Denn Bild generierende KIs sind nicht darauf spezialisiert, Schriftzüge und Texte (im Bild) korrekt wiederzugeben. Auch Adobe Firefly hat mit Text-Reproduktion noch so manche Schwierigkeiten.

Im Praxistest konnte ich weder mit der (Prompt)Text »Nike Swoosh« noch mit »Text NIKE« Logo oder Schriftzug generieren. Die KI ersetzte die markierte Stelle folgendermaßen:

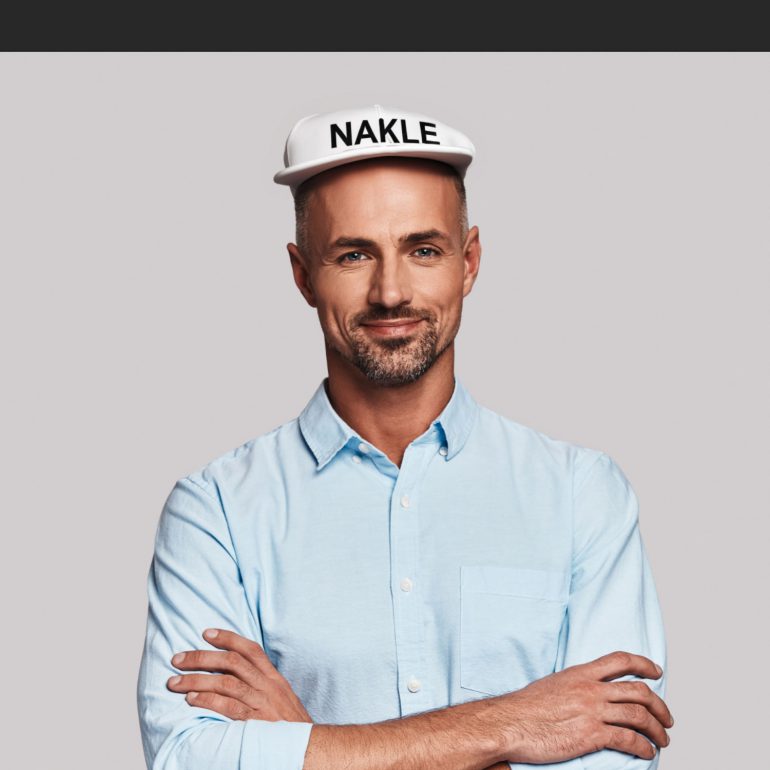

Auch Versuche mit anderen Bildern zeigen: KI und Text vertragen sich nicht sehr gut:

Ob es also dem Urheber des Videos wirklich gelungen ist, in nur einem Schritt den Schriftzug „Nike“ zu erzeugen, bezweifle ich. Auch deswegen, weil im Video an keiner Stelle zu sehen ist, welche Prompts der User verwendet hat. Das hätte aber der Glaubwürdigkeit des Videos sicher nicht geschadet.

Hinzu kommt, dass dieses Logo den strengen Corporate-Design-Regeln der Marke Nike vermutlich nicht entsprochen hätte:

Texte und Logos in einem Bild einzufügen, ist aber keine echte Hürde für einen erfahrenen Grafiker. Das geht natürlich auch ganz ohne KI. Daher habe ich das Nike-Logo nach konventionellem Regeln eingefügt. Dauer: Etwa 30 Sekunden.

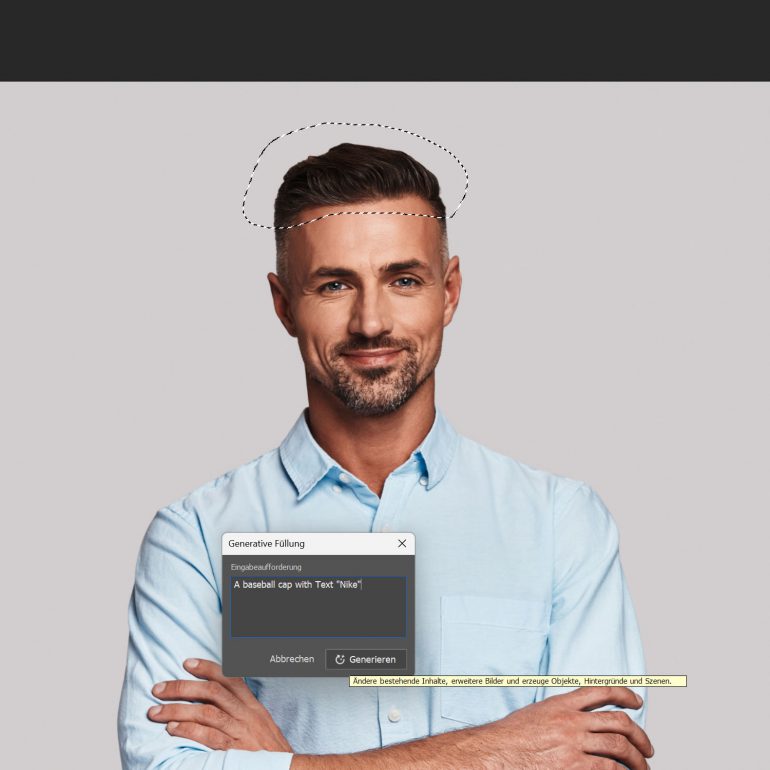

Schritt 2 – Körper und Hintergrund

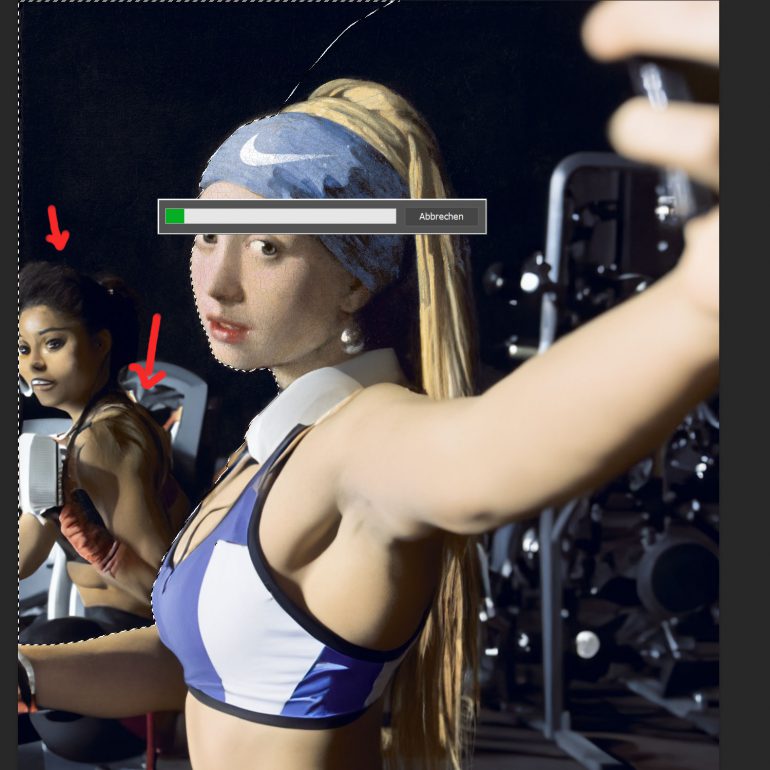

Im nächsten Schritt habe ich, analog zum Video, versucht, Körper und Hintergrund mittels Prompt »A girl in a gym making a selfie« zu ersetzen. Welchen Text der Urheber des Videos dazu verwendet hat, ist – wie bereits in Schritt 1 erwähnt – unbekannt.

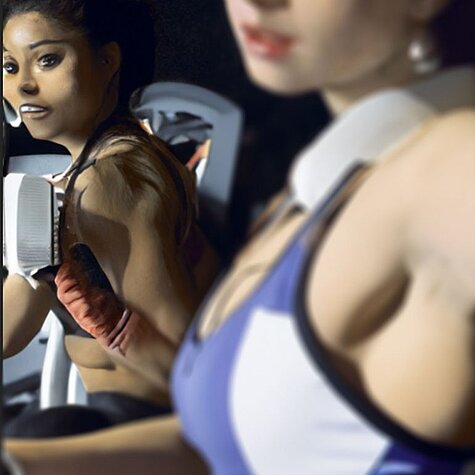

Die KI bietet nach jeder Berechnung 3 Vorschläge an. In diesem Fall waren 2 – nennen wir sie »akzeptable« – Ergebnisse dabei, die man als Grundlage zur Weiterbearbeitung verwenden kann. Man merkt aber auch hier ganz klar, dass die Reproduktion von Menschen und Gliedmaßen keine Stärke der KI ist. Solche Bildteile müssen nach wie vor manuell entfern und ersetzt werden. Vorausgesetzt man will ein respektables Ergebnis und keinen Social Media Gag.

Gliedmaßen realistisch zu erzeugen, das ist nicht die Stärke der generativen KI.

Kurioses Detail: Nackte Haut(stellen) über Generative Fill zu bearbeiten, und seien es auch nur Unterarme, ein Hals oder ein Bein, verstößt gegen die Nutzungsbedingungen von Adobe Generative AI. Auch wenn diese (nackten) Pixel von der KI selbst generiert wurden.

Die Person mit den verzerrten Gesichtszügen links hinten ist das Ergebnis der KI. Aber eben diese Pixel können durch dieselbe KI weder entfernt noch bearbeitet werden. Weil das gegen die eigenen Richtlinien verstößt.

Der ausgewählte Bereich wurde, trotz anders lautender Fehlermeldung, nicht entfernt. Die Pixel mit der »nackten Haut« musste ich manuell entfernen.

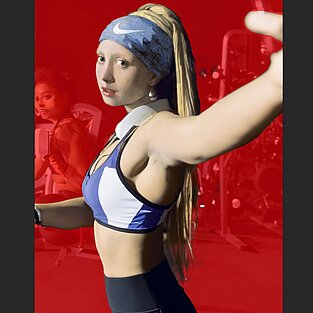

Schritt 3 – Nachbearbeitung

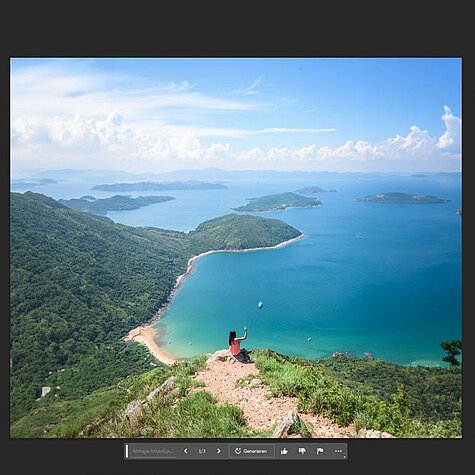

Mit etwas Mühe konnte ich den KI-generierten und etwas merkwürdigen Hintergrund ersetzen. Farben und Belichtung sind – vermutlich für einen Laien – OK, aber aus meiner Sicht weit davon entfernt, perfekt zu sein. Ich habe also das Selfie-Girl freigestellt und einen passenden Hintergrund eingefügt. Mit einigen Ebenen-Einstellungen bin ich auf dieses Resultat gekommen. Für ein Social-Media-Posting ausreichend, für eine hochwertige und druckreife Werbung jedoch ungeeignet.

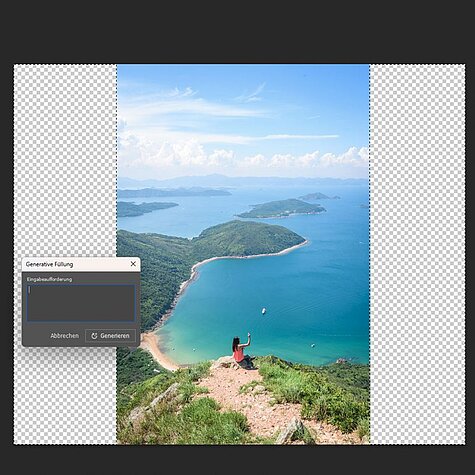

Zusammenfassend hatte ich den Eindruck, dass man einige Arbeitsschritte ganz gut mit Generative Fill erledigen kann. Hier sei vor allem die Funktion »Format Erweiterung« (Expand) erwähnt. Vorausgesetzt, man ignoriert die Unschärfe der neu erzeugen Pixel, erleichtert diese Funktion das Arbeiten.

Doch bei der Erzeugung von Texten, Gesichtern, Körpern oder einfachen Hintergrundelementen, hat die KI noch große Schwächen. Ob und wann diese beseitigt werden, darüber wird viel spekuliert. Fakt ist: Niemand kann das derzeit seriös beantworten:

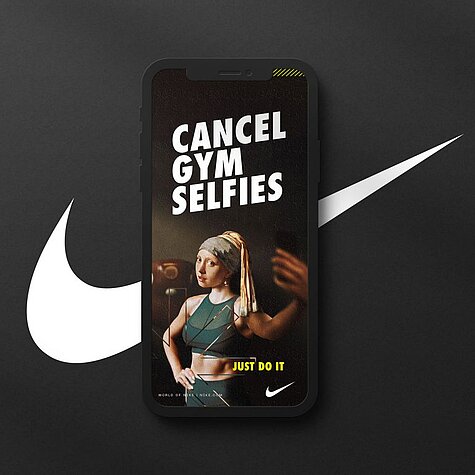

Schritt 4 – Challenge. Arbeiten (fast) ohne KI

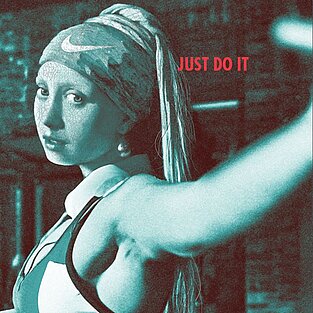

Am Ende habe ich mir selbst eine neue Aufgabe gestellt und versucht, ein Resultat herzustellen, das einem Gemälde zumindest sehr ähnlich sieht. So als hätte Vermeer selbst die Werbeanzeige »gemalt«. Dazu habe ich zunächst passendes Stock-Material recherchiert, mittels Generative Fill den Bildausschnitt erweitert und mit einigen Einstellungen, Filtern und Funktionen die Anmutung eines Gemäldes hergestellt. Den „Selfie-Arm“ habe ich eigenhändig freigestellt, neu belichtet und an die Perspektive angepasst.

Abschließend noch Text, Logos und Icons platziert und in das richtige Format gebracht.

Fazit:

Das Tool leistet zwar gute Arbeit, wenn es um das Erweitern eines Bildausschnitts geht. Oder das Entfernen von Hintergrundelementen. Es arbeitet „non destructively“, man kann also die generierte Änderung als eigene Ebene jederzeit wegklicken, ohne das ursprüngliche Bild zu zerstören.

Probleme hat die KI aber jedenfalls bei der Erzeugung realistischer Körper und Körperteile. Sowohl bei Menschen als auch bei Tieren. Die Ergebnisse wirken teilweise verzerrt bis grotesk. Etwas, was kein Kunde in einer hochwertigen Werbeanzeige sehen will. Außer vielleicht, um bewusst auf Fehler hinzuweisen (Vielleicht bei einer Werbung für Schönheitschirurgen geeignet?).

Generative Fill ist außerdem kein Ersatz für eine komplette Grafikabteilung, sondern in erster Linie ein neues Hilfsmittel, um Grafikern ihre Arbeit zu erleichtert.

Was außerdem oft vergessen wird: zu den Aufgaben eines Grafikers zählt bei weitem nicht nur die Bildmanipulation oder das Erstellen kreativer Werbeanzeigen. Grafiker müssen oft sehr individuelle und Vorgaben des Kunden umsetzen. Fotostile & spezifische Designelemente, auf die keine KI trainiert ist.

Ob und wann Adobe die aktuellen Mängel der Generative AI beseitigen wird, kann derzeit nicht seriös beantwortet werden. Immer wieder hört man, das seien doch nur Kinderkrankheiten. Aber auch das ist spekulativ. Denn niemand kann sagen, wie viel Geld die Silicon-Valley-Monopole weiterhin bereit sind, in die Entwicklung dieser Tools zu investieren. Verbesserungen und Updates setzen ja oft immense Ressourcen voraus (Energie, Mitarbeiter, Infrastruktur, Speicherplatz). Ebenfalls ungeklärt und nicht öffentlich bekannt ist die zukünftige Monetarisierung dieser Technologie. Denn irgendwann müssen die gigantischen Entwicklungskosten refinanziert werden. Und diese Kosten werden freilich an die User, die derzeit kostenlos experimentieren dürfen, weitergegeben. Viele offene Fragen also, und das in Zeiten, wo Energie gespart und CO₂ reduziert werden muss, die Gesellschaft also vor ganz anderen, großen Herausforderungen steht.